AI编程 内置模型选择指南

模型选择指南 (Model Selection)

1、技能概述

根据具体开发任务的特点,选择最合适的 AI 模型,以平衡响应速度、代码质量和稳定性。

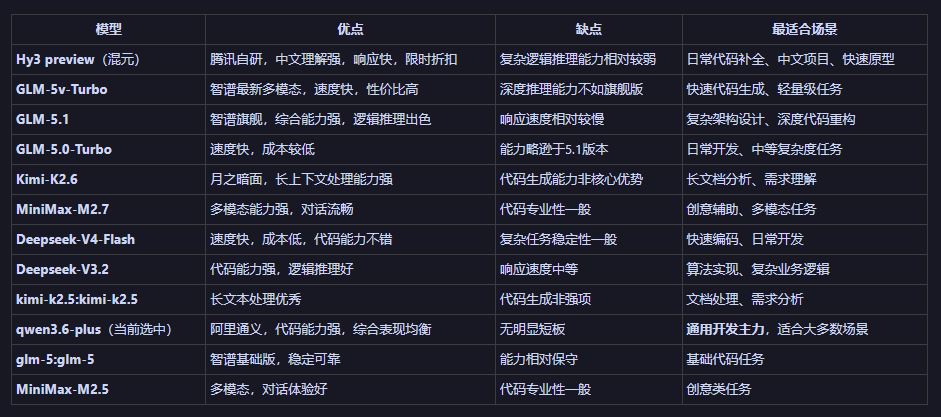

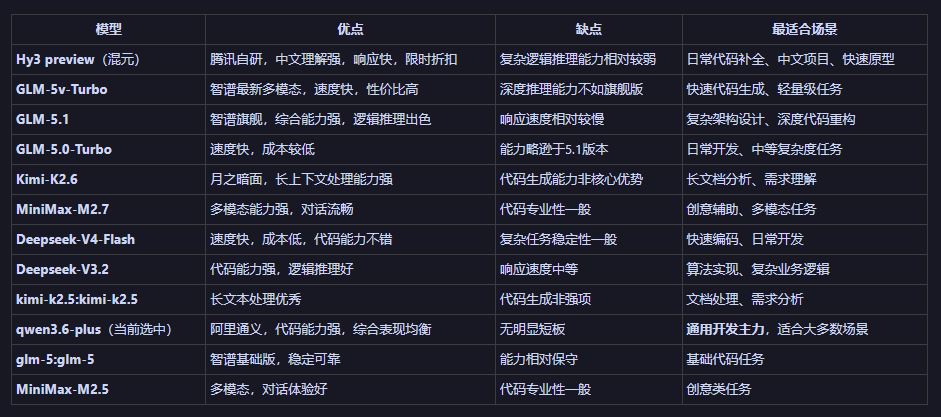

2、内置模型对比

3、选型建议

3.1、按任务类型选择

| 任务类型 | 推荐模型 | 原因 |

|----------|----------|------|

| **日常开发主力** | `qwen3.6-plus` | 综合表现最佳,代码能力强且稳定 |

| **追求速度/性价比** | `GLM-5v-Turbo` 或 `Deepseek-V4-Flash` | 响应快,成本低 |

| **复杂架构/算法** | `GLM-5.1` 或 `Deepseek-V3.2` | 深度推理能力强 |

| **中文项目/腾讯生态** | `Hy3 preview`(混元) | 中文理解优秀,有限时折扣 |

| **长文档/需求分析** | `Kimi` 系列 | 长上下文处理能力强 |

3.2、按复杂度选择

- **简单任务**(语法查询、代码补全、样式调整)→ `Hy3 preview` 或 `GLM-5v-Turbo`

- **中等任务**(接口开发、页面优化、业务模块)→ `qwen3.6-plus`(首选)或 `GLM-5.0-Turbo`

- **复杂任务**(架构设计、深度重构、算法实现)→ `GLM-5.1` 或 `Deepseek-V3.2`

4、 使用提示

- 不同模型会随官方更新持续优化

- 建议根据具体任务动态切换模型

- 当前默认推荐 `qwen3.6-plus` 作为通用开发主力

1、技能概述

根据具体开发任务的特点,选择最合适的 AI 模型,以平衡响应速度、代码质量和稳定性。

2、内置模型对比

3、选型建议

3.1、按任务类型选择

| 任务类型 | 推荐模型 | 原因 |

|----------|----------|------|

| **日常开发主力** | `qwen3.6-plus` | 综合表现最佳,代码能力强且稳定 |

| **追求速度/性价比** | `GLM-5v-Turbo` 或 `Deepseek-V4-Flash` | 响应快,成本低 |

| **复杂架构/算法** | `GLM-5.1` 或 `Deepseek-V3.2` | 深度推理能力强 |

| **中文项目/腾讯生态** | `Hy3 preview`(混元) | 中文理解优秀,有限时折扣 |

| **长文档/需求分析** | `Kimi` 系列 | 长上下文处理能力强 |

3.2、按复杂度选择

- **简单任务**(语法查询、代码补全、样式调整)→ `Hy3 preview` 或 `GLM-5v-Turbo`

- **中等任务**(接口开发、页面优化、业务模块)→ `qwen3.6-plus`(首选)或 `GLM-5.0-Turbo`

- **复杂任务**(架构设计、深度重构、算法实现)→ `GLM-5.1` 或 `Deepseek-V3.2`

4、 使用提示

- 不同模型会随官方更新持续优化

- 建议根据具体任务动态切换模型

- 当前默认推荐 `qwen3.6-plus` 作为通用开发主力

本站大部分文章、数据、图片均来自互联网,一切版权均归源网站或源作者所有。

如果侵犯了您的权益请来信告知我们删除。邮箱:1451803763@qq.com